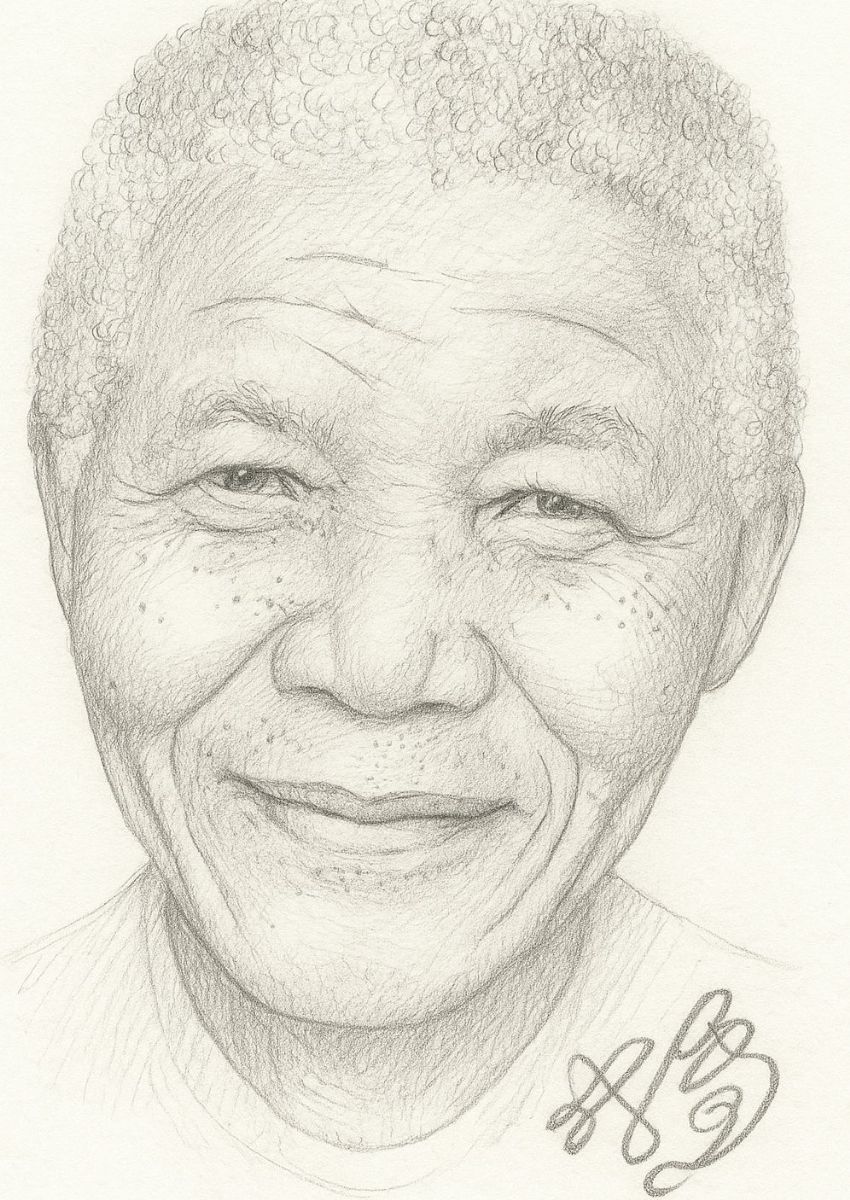

许多人第一次听说曼德拉(Nelson Mandela,1918~2013)当选总统时,都会错愕地说:「我清楚记得他在狱中去世的新闻画面。」这种大规模的错误记忆,被称为「曼德拉效应」(Mandela Effect)。

它说明人类记忆不是录影带,而是每次回想时都在重建的神经活动。当微小误差透过媒体传播并被群体强化,最终可能凝固为坚信不疑的「事实」。

生成式AI的出现,让这个现象进入危险的新阶段。过去的错误记忆源于人脑的模糊回想,如今却可能来自精心制作的數字幻象。AI能轻易生成高度拟真的内容,例如「C-3PO全银色剧照」或「皮卡丘黑色尾巴百科条目」。这些虚构细节真实得足以欺骗未经查证的观者,一旦在社群媒体病毒式扩散,说服力远超过去的谣言。

更可怕的是,AI生成的不只是单一图片或文字,而是包含照片、影片与文章的完整「证据链」,让虚假记忆看似天衣无缝。

同时,AI内容正以惊人速度污染信息生态。当人们试图验证记忆时,查找结果往往充斥大量口径一致的错误答案,形成信息回音室。社群演算法又偏好新奇与争议性内容,AI制造的谣言正符合这些条件,于是错误信息在推送与点击间不断循环,甚至被推升至主流讨论。

更令人忧心的是,AI不仅能放大既有错误,还能凭空创造从未存在的记忆。想像有人利用AI虚构一个九〇年代的卡通角色,生成动画片段、广告影像与周边商品照片,再编造讨论贴文。这些充满怀旧元素的内容迅速走红,10年后,当年的孩童已成年,脑中仍保留模糊印象。当有人发问「你还记得这个卡通吗?」便会有大批网友响应,甚至补充剧情细节。

一个根本不存在的角色,竟成为集体的童年回忆。

此时,AI已不是错误的放大器,而是记忆的原始编造者,绕过既有事实,直接向集体意识注入从未发生过的过去。

这绝非单纯趣闻,而是深具社会风险的征萬億。当伪造记忆结合拟真图像、详尽文本和庞大社群互动,真实与虚构的边界将愈加模糊。它可能动摇人们对历史的理解,使司法证据效力大打折扣,甚至撼动政治共识。如果某个重大事件被AI大规模改写,数百万人因而误解,后果难以想像。更极端的情境是,当AI生成的虚假内容数量超过真实信息时,查找引擎甚至可能将错误答案置于前列。此时,真相反而成了需要额外努力证明的「少数说法」,我们将进入一个「真相倒置」的时代。

因此,社会必须建立數字免疫系统。技术上需要更精准的检测工具,識別内容是否为AI生成。制度上,平臺应透明标注AI内容,并对恶意散布者设立规范;教育上,更需强化數字素养,培养理解演算法运作的能力,养成交叉验证与批判思考的习惯。

在个人层面,每位使用者都应保持警觉。我们必须追溯信息来源,不轻信单一说法,也不要因「众人皆信」就放下怀疑。面对任何看似「众所周知」的信息,都应该问3个问题:来源是什么?是否有可靠第三方验证?是否符合基本逻辑与常识?

AI的曼德拉效应提醒我们,过去不再是坚固不动的参考点,而是随著數字技术持续被改写的场域。在这个由演算法与幻象交织的记忆迷宫里,真相的价值从未如此珍贵。当记忆本身都能被制造,守护真实便成为每个人的责任,而我们的选择,将决定未来時代如何理解过去、认识现在。