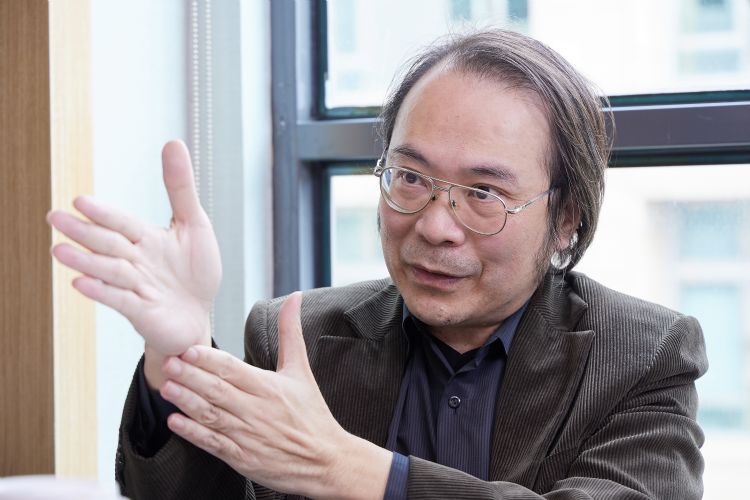

简立峰:超小LLM将成风潮 服务器、边缘端可望受惠

对话式人工智能(AI)蔚为风潮之下,背后的大型语言模型(LLM)进展也相当受瞩。前Google台湾董事总经理简立峰日前指出,仅有少数大企业可开发超大LLM,其他研发则会走向超小型LLM,应用面会逐渐走向企业服务器,再久一点便是边缘端,而电动车也是相当适合的应用场景。

日前参与AI新创犀动智能的记者会时,简立峰谈到,ChatGPT带动生成式AI(Generative AI)风潮,连带彻底改变内容生成、人机互动的方式。

许多企业对引进如同ChatGPT的服务跃跃欲试,但他认为,不可能完全在公有云上使用,估计1年内会进入私有云、企业服务器上部署。愈来愈多企业将使用AI工具提高工作效率,而企业建置「定制化AI大脑」的需求,也将百家争鸣。

他也提到,近5年内LLM迅速发展,与以往科技进展的时间轴体验,已经很不一样。未来相关技术如何演变,让人充满无限想像。

2018年OpenAI释出首代GPT模型,参数量约为1.17亿个。2020年问世的GPT-3模型参数量已达1,750亿个,2022年出现的GPT-3.5模型参数量相同。

2023年3月中,OpenAI发表GPT-4模型。此前,外界曾预计可能比上一代的参数量高出500倍。但GPT-4参数量目前未公开。

简立峰指出,史丹佛大学(Stanford University)、加州大学柏克莱分校(UC Berkeley)等机构的学者,已在开发降规版的语言模型。毕竟全球只有少数几家科技巨擘可开发出超大LLM,其他大部分的研发应会致力于发展超小LLM。

史丹佛研究团队3月发表了被称为羊驼的Alpaca模型,是以Meta LLaMA模型为基础微调而来。LLaMA模型系列有不同参数量,该团队用的是70亿参数量者,称可接近GPT-3.5的表现,但大幅缩小模型、压低训练成本。

不过该团队也强调,Alpaca模型仅作为学术研究,主要基于三点考量:Meta LLaMA授权条款中包含非商业化的规定;再者,指令数据来自OpenAI,也包含竞业禁止条款;第三,团队并未设置适当安全措施,因此不适用于广泛部署。

而一般企业是否应重新采购AI级的服务器?简立峰认为,采购内含GPU的服务器确实必要,近期也有服务器业者反应接到「急单」。建议相关业者应及早布局,而非等到技术普及后才进场。

关于边缘端应用的想像,他表示,自然语言生成将提升物联网(IoT)、端到端应用的商机。此外,电动车也是相当适合的场景。不过,电动车内的语音应用还是得用到云端运算,电动车业者如Tesla也会希望相关应用建置在自家的云端。

TeslaCEOElon Musk日前与数百位科技业代表一同连署呼吁,全球应暂缓推进超越GPT-4等级的AI研发。然媒体随后揭露,Musk购入大量GPU,且成立新公司X.AI。

因此,上述的连署信虽揭示AI研发竞赛的风险,但Musk的举动让外界认为,AI竞赛愈趋白热化,没有一家业者真的会停下发展的脚步。

针对相应AI热潮的芯片发展,简立峰认为,GPU和AI芯片是两件事,较为通用的GPU目前尚无明显的竞品。台湾目前仍较少专做自然语言技术的AI芯片。

曾有人估计,训练1,760亿参数量的语言模型,要用到上千个GPU,但Stanford、Berkeley等团队较小模型的训练,可能仅需10个GPU左右。日后更小模型的训练甚至可能只需1~2个GPU。训练所需的GPU数量通常大于维运服务所需的GPU数。

犀动智能CEO暨共同创始人沈书纬指出,因公司主打自然语言技术,2019年成立之初曾有人问过,相关技术若不能做到芯片上,能否做到现场可程序化闸阵列(FPGA)上。但半年以前,自然语言在市场上还是冷门话题,目前尚未看到适合的专用芯片,不过另一方面也是因为团队专注于云端运算。

开发边缘AI芯片的耐能智能日前指出,近期将发表轻量型NanoGPT专用芯片。另一AI芯片新创创鑫智能则开发云端推论系统用芯片。

责任编辑:毛履万亿